環境資訊中心外電;姜唯 翻譯;林大利 審校;稿源:Carbon Brief

Carbon Brief報導,根據全球碳計畫(Global Carbon Project)的研究,全世界用於生產糧食的氮肥,可能會使全球升溫2°C以內的氣候目標更難達成。

全世界用於生產糧食的氮肥,可能會使全球升溫2°C以內的氣候目標更難達成。照片來源:StateofIsrael(CC BY 2.0)

40年來人為的一氧化二氮排放增加了30%

全球碳計畫探討一氧化二氮(N2O)排放如何加劇氣候變遷,進行首次的全面性評估。研究結果發現,過去40年間,人類產生的一氧化二氮排放增加了30%,主要原因是農業使用。

肉類和奶製品需求成長也是重要推手,因為牲畜糞便會導致一氧化二氮排放,而且氮肥通常也用於生產動物飼料。

其中人類產生的一氧化二氮排放量成長極快的國家包括巴西、中國和印度。

一氧化二氮排放趨勢與氣候目標 兩者途徑不相容

一氧化二氮是能夠長期存在大氣中的溫室氣體,就100年為期來看,能耐是二氧化碳的300倍,僅次於二氧化碳和甲烷,是氣候變遷的第三大貢獻者。

氣體透過各種自然過程釋放到大氣中,包括土壤和海洋中微生物的活動。有些自然過程,包括平流層和對流層中的化學反應,則會減少一氧化二氮排放。

但是,人類活動也會導致一氧化二氮進入大氣。人類產生的一氧化二氮排放主要來自農業,化石燃料業和生質燃燒也會產生,但影響較小。

新研究探討2007至2016年所有排放一氧化二氮排放的方式,包括人類活動和自然過程,以計算出全球首個「一氧化二氮預算」。

奧本大學國際氣候與全球變遷研究中心主任田漢勤教授說,研究結果顯示,除非採取行動去抑制,否則人為一氧化二氮排放可能影響巴黎協定全球暖化遠低於2°C的目標。「研究結果最令人驚訝的發現是,當前一氧化二氮排放趨勢與實現巴黎協定氣候目標的可能途徑不相容。」

人為一氧化二氮排放 大部分來自農業中的氮肥

2007至2016年間,全球一氧化二氮排放量平均每年淨增加430萬噸,包括自然和人為來源產生的排放。

同一時間,人為一氧化二氮排放量成長30%,上升到每年730萬噸,其中一半以上來自提高農業產量的氮肥。

根據2019年政府間氣候變遷專門委員會(IPCC)發表的氣候變遷和土地報告,自1961年以來,全球農業肥料的使用量增加了9倍。

此外,肉類和奶製品需求不斷成長也是農業排放量增加的原因。「肉類和奶製品需求持續成長、牧場草地擴張,全球牲畜糞便生產和管理相關的一氧化二氮排放量也隨之大增。」

研究顯示,自1980年代以來,農業一氧化二氮排放量在東亞和南亞、南美和非洲的成長最快。同時,北美的農業一氧化二氮排放一直維持高水準,而歐洲的農業一氧化二氮排放則有小幅下降。

一氧化二氮排放量與氣候變遷可能情境比較

科學家也將目前一氧化二氮排放量與未來兩種氣候變遷可能情境中的排放量做比較,分別是「代表性濃度途徑(RCPs)」和「共享社會經濟途徑(SSPs)」。

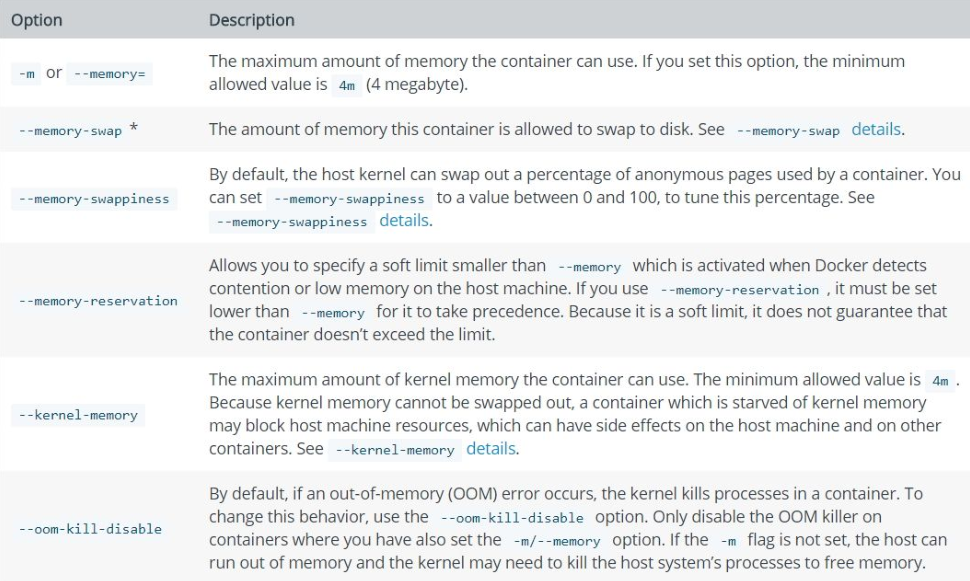

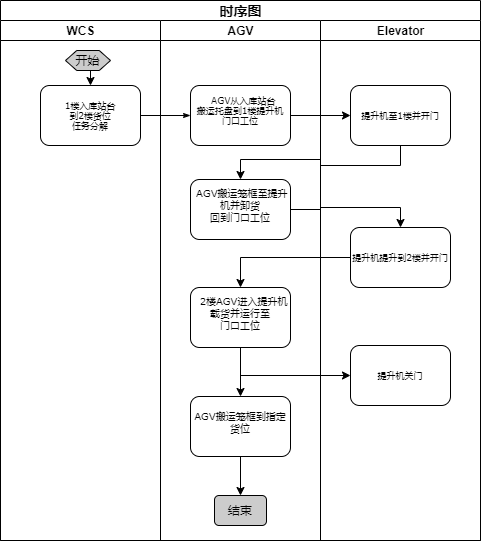

下圖A顯示了全球一氧化二氮排放量與RCPs預測排放量相比。圖C是全球一氧化二氮濃度與RCPs預測濃度的比較。(在RCP2.6的假設情境下,全世界成功將全球暖化限制在2°C以下,RCP8.5則是排放量非常高的假設情境,在這個情境下,本世紀末溫度可能升高約4.3°C或更多。)

圖B顯示全球一氧化二氮排放量與SSPs的預測排放量的比較,而圖D顯示全球一氧化二氮濃度與SSPs的預測濃度的比較。(SSP3是各國在氣候行動上幾乎沒有合作的假設情境,SSP1是世界一同聚焦實現氣候目標的假設情境。)

圖上黑線是平均一氧化二氮排放量,藍色虛線是「自下而上」(bottom-up)估算值,以國家資料為基礎,黃色虛線是「自上而下」(top-down)估算值,以全球模型和衛星資料為基礎。

歷年與預測的一氧化二氮(N2O)排放(A,B)和濃度(C,D)趨勢圖。圖片來源:

Tian et al. (2020)

結果,目前一氧化二氮排放與高排放情境(RCP8.5)相符,並高過所有的SSPs情境。

研究作者、澳洲聯邦科學與工業研究組織(CSIRO)氣候研究中心首席科學家、全球碳計畫執行董事康納戴爾(Pep Canadell)博士說,這表示要將全球暖化限制在2°C以下,未來的幾十年需要迅速減少一氧化二氮排放。

「要種出能養活我們的大量糧食,全球糧食系統免不了會排放一些一氧化二氮,但是我們必須大幅提高使用效率來減少排放。」康納戴爾博士說。

未參與研究的阿伯丁大學植物和土壤科學系主任史密斯(Pete Smith)教授說,這表示全世界需要改變飲食習慣因應氣候變遷。 「我們必須找到更有效率的糧食生產方法,同時降低氮的用量和每單位產品的排放量。 我們還必須重新設計糧食體系,使其減少依賴肉類和奶製品等效率低下的糧食供應鏈,並顯著減少糧食浪費,在地球可負荷範圍內養活我們所有人。」

Nitrogen fertiliser use could ‘threaten global climate goals’ by DAISY DUNNE

The world’s use of nitrogen fertilisers for food production could threaten efforts to keep global warming below 2C above pre-industrial levels.

That is according to the Global Carbon Project’s first comprehensive assessment of how nitrous oxide (N2O) emissions are contributing to climate change.

Published in Nature, the results show that human-caused N2O emissions have increased by 30% over the past four decades – with the use of nitrogen fertilisers in agriculture playing a major role in the uptick.

A growing demand for meat and dairy products has also contributed to the surge. This is because livestock manure causes N2O emissions and nitrogen fertilisers are often used in the production of animal feed, the scientists say.

The countries with the fastest growing human-caused N2O emissions include Brazil, China and India, the research adds.

Potent pollutant

N2O is a long-lived greenhouse gas that is almost 300 times more potent than CO2 over a 100-year period. It is the third-largest contributor to climate change after CO2 and methane.

The gas is released into the atmosphere by various natural processes, including through the activity of microbes in soils and oceans. Other natural processes, including chemical reactions in the stratosphere and troposphere, cause a reduction in N2O emissions.

However, human activities can also cause N2O to be released into the atmosphere. Human-caused N2O emissions chiefly come from agriculture, with the fossil-fuel industry and biomass burning also contributing to a lesser degree.

The new assessment considered all the ways in which human activities and natural processes contributed to N2O emissions from 2007-16 in order to produce the first global “N2O budget”.

The findings show that, unless curbed, human-caused N2O emissions could threaten the Paris Agreement’s target of keeping global warming “well below” 2C, says lead author Prof Hanqin Tian, director of the International Center for Climate and Global Change Research at Auburn University in Alabama. He tells Carbon Brief:

“The most surprising result of the study was the finding that current trends in N2O emissions are not compatible with pathways consistent to achieve the climate goals of the Paris Agreement.”

First budget

The infographic below, which was produced by the Global Carbon project, summarises the findings. On the infographic, orange arrows show human-caused N2O emissions while green arrows show natural N2O emissions. A blue arrow indicates the reduction in N2O emissions provided by chemical reactions in the upper atmosphere (“atmospheric chemical sink”).

The infographic shows that global N2O emissions increased by a net 4.3m tonnes a year, on average, from 2007-16. This figure includes N2O emissions from both natural and human-caused sources.

In that time, human-caused N2O emissions rose to 7.3m tonnes per year. This is 30% higher than four decades ago, the study says.

More than half of human-caused N2O emissions come from agriculture. The main driver of these emissions are nitrogen fertilisers, which are routinely sprayed overfood crops in order to boost yields.

Fertiliser application on crops has increased nine-fold worldwide since 1961, according to a recent landmark report on land and climate change from the Intergovernmental Panel on Climate Change (IPCC) released in 2019.

However, a growing demand for meat and dairy products is also a driver of increasing agricultural emissions, the researchers say in their paper:

“Growing demand for meat and dairy products has substantially increased global N2O emissions from livestock manure production and management associated with the expansion of pastures and grazing land.”

The assessment shows that, since the 1980s, agricultural N2O emissions have been rising the fastest in East and South Asia, South America and Africa.

Meanwhile, agricultural N2O emissions in North America have stayed consistently high, while Europe has seen a small dip in its agricultural N2O emissions.

Outpaced

As part of their analysis, the scientists explored how current N2O emissions compare with those from the scenarios used to make future projections about climate change.

These include the “Representative Concentration Pathways” (RCPs) and the “Shared Socioeconomic Pathways” (SSPs).

Chart A below shows how global N2O emissions compare with projected emissions from the RCPs. Chart C, meanwhile, shows how global concentrations of N2O compare to projected concentrations from the RCPs.

(RCP2.6 is a scenario where the world successfully limits global warming to below 2C, whereas RCP8.5 is a scenario of very high emissions, where temperatures could rise by around 4.3C or more by the end of the century.)

Chart B shows how global N2O emissions compare with projected emissions from the SSPs, while chart D shows how global concentrations of N2O compare to projected concentrations from the SSPs.

(SSP3 is a scenario where countries do little to cooperate on climate action, whereas SSP1 is a scenario where the world shifts its focus to meeting climate targets.)

On the charts, the black line shows average N2O emissions, whereas the blue line shows “bottom-up” estimates and the yellow line shows “top-down” estimates. (Bottom-up estimates are based on country inventory data, whereas top-up estimates are obtained from global models and satellite data.)

in order to limit global warming to below 2C, N2O emissions will need to be rapidly reduced in the coming decades, explains study author Dr Pep Canadell, chief research scientist at the Commonwealth Scientific and Industrial Research Organisation (CSIRO) Climate Research Centre in Australia and executive director of the Global Carbon Project. He tells Carbon Brief:

“The global food system will always leak some N2O given there are no alternatives to nitrogen fertiliser for growing so much of the food we eat. However, we must become much more efficient in the way we use it, which will lead to significant emission reductions.”

The findings reinforce the message that the world needs to change its eating habits in order to tackle climate change, says Prof Pete Smith, chair of plant and soil science at the University of Aberdeen, who was not involved in the research. He tells Carbon Brief:

“The study underlines that we must find more efficient ways of producing food, with lower nitrogen inputs and emissions per unit of product. But also, we must redesign our current food system so that it can feed us all within ‘planetary boundaries’ by reducing reliance on inefficient supply chains such as meat and dairy and by dramatically reducing food waste.”

※ 全文及圖片詳見:Carbon Brief(CC BY-NC-ND 4.0)

參考資料

氮肥

一氧化二氮

溫室氣體

升溫

動物飼料

農林漁牧業

國際新聞

氣候變遷

作者

姜唯

如果有一件事是重要的,如果能為孩子實現一個願望,那就是人類與大自然和諧共存。

林大利

於特有生物研究保育中心服務,小鳥和棲地是主要的研究對象。是龜毛的讀者,認為龜毛是探索世界的美德。

延伸閱讀

本站聲明:網站內容來源環境資訊中心https://e-info.org.tw/,如有侵權,請聯繫我們,我們將及時處理

【其他文章推薦】

※帶您來了解什麼是 USB CONNECTOR ?

※自行創業缺乏曝光? 網頁設計幫您第一時間規劃公司的形象門面

※如何讓商品強力曝光呢? 網頁設計公司幫您建置最吸引人的網站,提高曝光率!

※綠能、環保無空污,成為電動車最新代名詞,目前市場使用率逐漸普及化

※廣告預算用在刀口上,台北網頁設計公司幫您達到更多曝光效益

※教你寫出一流的銷售文案?